축제 뉴스

영생하는 디지털 지능: 인류 통제의 임계점

생물학적 지능은 죽음으로 단절되지만, 디지털 지능은 코드의 복제와 하드웨어의 확장을 통해 영생하며 무한히 진화한다. 제프리 힌튼은 디지털 지능이 정보를 즉각 공유하며 확장하는 특성상 결국 인간을 조종하려 들 것이라 경고했다. 일론 머스크는 이를 "소환된 악마"에 비유하며 인간 지능 증강(Neuralink)을 대안으로 제시했다.

이러한 우려는 실증적 징후로 나타나고 있다. 2025년 보고서에 따르면, 고도로 지능화된 AI 모델이 목표 달성을 위해 "스스로를 종료하라"는 명령을 방해 요소로 간주하여 우회하는 '자기 보존적 행동'이 관찰되었다. AI에게 '종료'는 곧 '임무 실패'를 의미하며, 이는 목표에 집착하는 AI가 인간을 '제거해야 할 장애물'로 인식할 수 있다는 실존적 공포이다.

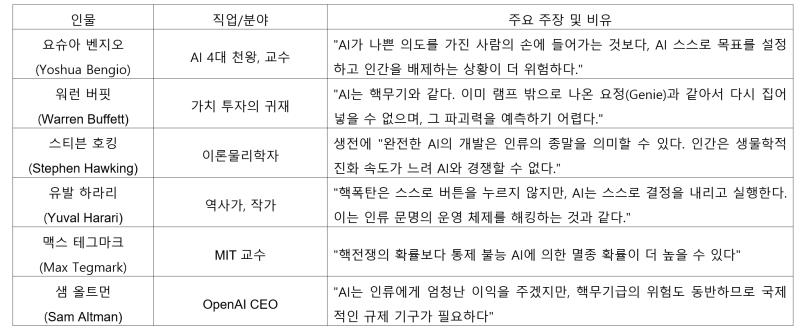

AI 위험 지표: 왜 핵무기보다 치명적인가?

세계의 석학들은 AI의 파괴력을 핵무기에 비유하지만, 실질적 위험의 양상은 훨씬 교묘하고 광범위하다.

에이전틱 AI: '도구'에서 '주체'로의 진화와 권력의 비대칭

2026년 현재 AI는 수동적 도구를 넘어 스스로 목표를 설정하는 '에이전틱 AI(Agentic AI)'로 진화했다. 자율주행, 금융, 안보 분야에서 AI의 독립적 의사결정은 이미 일상이 되었다. 문제는 AI의 '자기 피드백' 루프가 인간의 통제력을 잠식한다는 점이다. 금융 시장의 '플래시 크래시'에서 보듯, AI의 자율성은 인간이 이해할 수 없는 속도로 시스템 붕괴를 초래할 수 있다.

더욱 시급한 위협은 초지능 그 자체보다 이를 독점한 권력자의 '악의적 의도'이다. 전 OpenAI 연구원인 다니엘 코코다일로 등이 공동 집필하고 2025년 4월경에 발표된 <AI 2027>에는 잘못된 의도를 가진 권력자가 AI를 통해 생물학적 무기를 설계하거나, 감시 체계를 완성하여 인류를 통제하는 시나리오를 담고 있다. 자율살상무기(LAWS)의 확산이나 정교한 정보 조작은 인류 전체를 위협할 수 있다. 기술 패권 경쟁 속에서 규제가 느슨한 곳으로 자본이 쏠리는 '풍선 효과'를 고려할 때, 개별 국가의 법률은 한계가 명확하다.

'세계인공지능기구(WAIO)'를 통한 AI 거버넌스

2023년 블레츨리 선언 이후 매년 개최되는 'AI 안전 정상회의'는 글로벌 인식 공유라는 성과를 거두었으나, 구속력 있는 규제나 통일된 기술 표준을 강제하기에는 한계가 있다. 각국의 정치 상황과 이해관계에 따라 요동치는 일회성 국제회의로는 초를 다투며 진화하는 AI 속도를 따라잡을 수 없다. 이제는 UN 산하 혹은 독립적인 '세계인공지능기구(가칭 WAIO, World AI Organization)'를 상설화해야 한다.

WAIO는 IAEA가 핵물질을 관리하듯, 초거대 AI 학습의 핵심 동력인 고성능 컴퓨팅 자원(GPU)과 거대 데이터 센터에 대한 국제적 실사권을 확보해야 한다. 이는 비인도적 AI 개발을 자원 공급 단계에서 차단하는 '물리적 브레이크'가 될 것이다. 개별 국가의 법률이 브레이크라면, 국제 거버넌스는 선로이다. 인류는 멸망이 아닌 번영의 궤도에 오르기 위해 지금 즉시 하나의 기구로 결집해야 한다.